Аннотация

В 2025 году профессор И Чжоу из Хунаньского университета выступил в качестве соответствующего автора двух статей, опубликованных в журнале IEEE Transactions on Robotics (TRO), одном из ведущих журналов в области робототехники. Эти работы демонстрируют значительный прогресс в оценке состояния на основе камер событий и систем SLAM, при этом данные системы захвата движения подтверждают предложенные методы в реальных высокоскоростных сценариях.

Статья Одна

Оценка состояния на основе событийной визуальной и инерциальной информации для высокоскоростных маневров

↑↑Нажмите чтобы посмотреть видеоинтервью с профессором И Чжоу

RSS 2024 "Событийный Визуально-Инерциальный Велометр"

В 2024 году команда профессора И Чжоу опубликовала статью "Событийный Визуально-Инерциальный Велометр" на ведущей конференции по робототехнике RSS. Через год исследовательская группа дополнительно усовершенствовала алгоритм и добавила больше экспериментальных проверок в реальных высокоскоростных сценариях, продемонстрировав превосходную производительность метода с точки зрения низкой задержки и высокой точности. Впоследствии статья "Оценка состояния на основе событийной визуальной и инерциальной информации для высокоскоростных маневров" была опубликована в ведущем журнале по робототехнике IEEE TRO.

Цитирование

X. Lu, Y. Zhou, J. Mai, K. Dai, Y. Xu and S. Shen, "Event-Based Visual-Inertial State Estimation for High-Speed Maneuvers," in IEEE Transactions on Robotics, vol. 41, pp. 4439-4458, 2025, doi: 10.1109/TRO.2025.3584544.

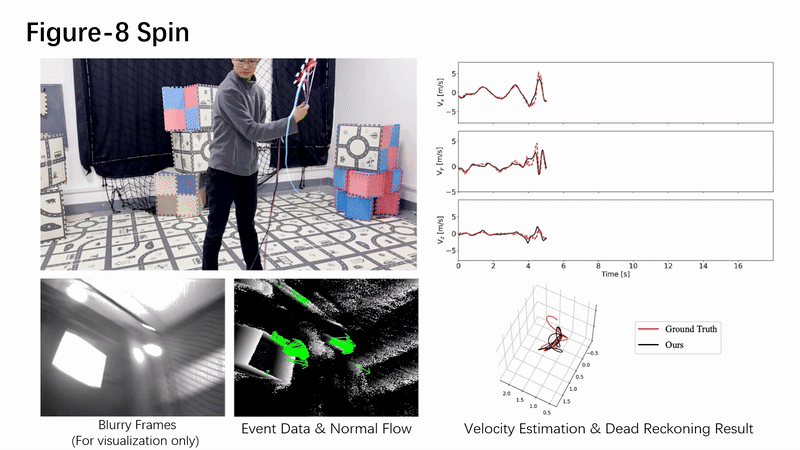

Данная статья инновационно предлагает метод оценки состояния высокоскоростного движения на основе камеры событий и блока измерения инерции (IMU), впервые достигая оценки линейной скорости в реальном времени только с использованием потоков событий и инерциальных данных. Она предоставляет новый подход к точной локализации в динамических сценариях, таких как БПЛА и высокоскоростные роботы. Исходя из первых принципов, исследовательская группа предложила новую конструкцию типа "велометра". С помощью объединения разреженного нормального потока со стерео-камеры событий с данными IMU и использования модели B-сплайна непрерывного времени она напрямую оценивает мгновенную линейную скорость, избегая зависимости традиционных методов от сопоставления признаков или структуры окружающей среды. Эксперименты показывают, что в реальных высокоскоростных сценариях (например, резкие повороты дронов, вращение на привязи и т.д.) этот метод снижает ошибку оценки скорости более чем на 50% по сравнению с существующими технологиями, одновременно удовлетворяя требованиям к вычислительной эффективности в реальном времени.

Рис. 1 Система захвата движения предоставляет эталонные траектории для камеры событий в данной статье, помогая валидировать предложенный метод.

Статья Два

ESVO2: Прямая визуально-инерциальная одометрия со стерео-камерами событий

На основе предыдущих исследований команда профессора И Чжоу сделала инновационные улучшения и предложила систему визуально-инерциальной одометрии на основе стерео-камер событий, сосредоточив внимание на оптимизации эффективности 3D-картографирования и точности оценки позы. Результаты исследования под названием "ESVO2: Прямая визуально-инерциальная одометрия со стерео-камерами событий" были опубликованы в ведущем журнале по робототехнике IEEE TRO.

Цитирование

J. Niu, S. Zhong, X. Lu, S. Shen, G. Gallego and Y. Zhou, "ESVO2: Direct Visual-Inertial Odometry With Stereo Event Cameras," in IEEE Transactions on Robotics, vol. 41, pp. 2164-2183, 2025, doi: 10.1109/TRO.2025.3548523.

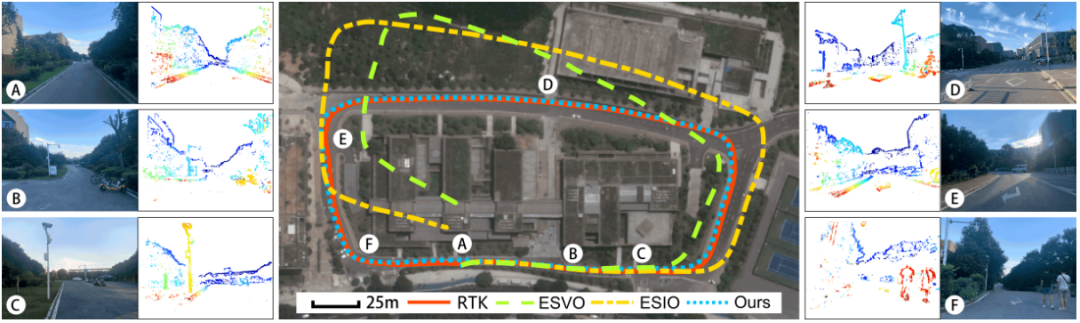

Разработав новую стратегию выборки контурных точек и объединения информации о глубине из временных и статических стерео-конфигураций, это исследование эффективно повышает полноту и вычислительную эффективность модуля картографирования. Для решения проблемы вырождения при оценке компонентов тангажа и рыскания положения камеры данное исследование вводит измерения IMU в качестве приоритетов движения и создает компактную и надежную оптимизационную систему back-end для достижения оценки в реальном времени смещений IMU и линейной скорости. Эксперименты показывают, что по сравнению с существующими основными алгоритмами предложенная система демонстрирует более высокую точность локализации и превосходную производительность в реальном времени в крупномасштабных открытых средах.

Рис. 2 Экспериментальные результаты локализации на территории Университета Хунань.

Система захвата движения предоставляет эталонные траектории для данной статьи, помогая валидировать предложенный метод.

Соответствующий Автор

И Чжоу является профессором и научным руководителем в Школе робототехники Хунаньского университета и директором лаборатории NAIL в Хунаньском университете. Он получил докторскую степень в Колледже инженерии и компьютерных наук Австралийского национального университета в 2018 году и был включен в национальную программу высококвалифицированных молодых талантов. Его исследования в основном сосредоточены на технологиях восприятия и навигации роботов на основе передовых визуальных датчиков, включая высокоскоростных автономных роботов, визуальную одометрию/SLAM, динамические визуальные датчики (событийное зрение) и теорию многовидовой геометрии. Основные достижения его исследований были опубликованы в авторитетных журналах и конференциях по робототехнике и компьютерному зрению, таких как IEEE T-RO, RSS и ECCV. В настоящее время он является заместителем редактора журнала IEEE Robotics and Automation Letters (RA-L).

О лаборатории NAIL: