Аннотация

Точное отслеживание 6D положения объектов имеет важное значение для задач манипуляции роботов, особенно в сложных сценариях сборки, таких как вставка штифта. Традиционные методы визуального отслеживания часто ограничены из-за перекрытий и шумов в визуальной информации, особенно в ситуациях, связанных с операциями роботизированной рукой. В данной статье представлена новая методика TEG-Track, предложенная командой под руководством профессора И Ляна из Института междисциплинарных информационных наук Университета Цинхуа, опубликованная в RA-L. TEG-Track повышает производительность обобщаемого трекинга 6D позиций за счет интеграции тактильного восприятия, и команда создала первый полностью аннотированный визуально-тактильный датасет для отслеживания положений объектов в руке в реальных условиях. Система сбора данных включает систему захвата движения NOKOV.

Код и Датасет: https://github.com/leolyliu/TEG-Track

Статья: https://ieeexplore.ieee.org/document/10333330/

Цитирование

Y. Liu et al., "Enhancing Generalizable 6D Pose Tracking of an In-Hand Object With Tactile Sensing," in IEEE Robotics and Automation Letters, vol. 9, no. 2, pp. 1106-1113, Feb. 2024, doi: 10.1109/LRA.2023.3337690.

Исследовательский фон

Надежность роботизированной манипуляции зависит от точного восприятия состояния движения объектов, удерживаемых в руке. Существующие методы отслеживания 6D позиций обычно полагаются на данные RGB-D, которые работают плохо в сценариях с перекрытиями и столкновениями с окружающей средой. В отличие от этого, тактильные датчики могут напрямую ощущать геометрию и информацию о движении зоны контакта, предоставляя дополнительные вспомогательные сигналы для отслеживания.

Системная структура

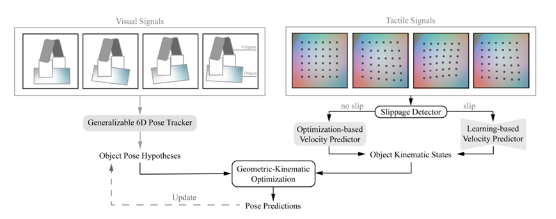

Суть TEG-Track заключается в использовании тактильных кинематических сигналов для усиления визуальных трекеров через стратегию геометрической оптимизации движения.

Датасет

Синтетический набор данных включает экземпляры объектов различных геометрических форм, выбранных из датасета ShapeNet, тогда как реальный набор данных состоит из 200 видеороликов, охватывающих 17 различных объектов в 5 категориях. Система сбора данных включает роботизированную руку, тактильные датчики, RGB-D датчики, систему захвата движения NOKOV и объекты.

Экспериментальные результаты

В экспериментах сравнивалось улучшение производительности TEG-Track на трех типах визуальных трекеров: основанных на ключевых точках (BundleTrack), регрессии (CAPTRA) и шаблонах (ShapeAlign). Результаты показывают, что TEG-Track снизил среднюю ошибку вращения на 21,4% и ошибку перемещения на 30,9% в реальных данных.

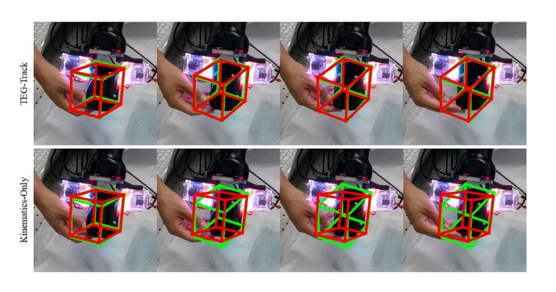

Качественные результаты длинных траекторий в реальных данных показывают красные и зеленые рамки, представляющие предсказанные и истинные позиции объекта в руке соответственно.

Моделируя шумовые паттерны тактильных сигналов, была проверена производительность TEG-Track при разных уровнях качества тактильных сигналов, демонстрируя большую стабильность и надежность по сравнению с базовыми методами, полагающимися только на тактильные или визуальные входные данные.

TEG-Track достиг скорости обработки 20 кадров в секунду в сценариях многофреймовой оптимизации с низкими дополнительными вычислительными затратами, что делает его подходящим для реального времени.

Система захвата движения NOKOV используется для получения истинной информации о положении объектов для сравнения с предсказанными позициями.